Does increasing reliance on AI-driven, seamless interactions reduce the depth and quality of human to human connection?

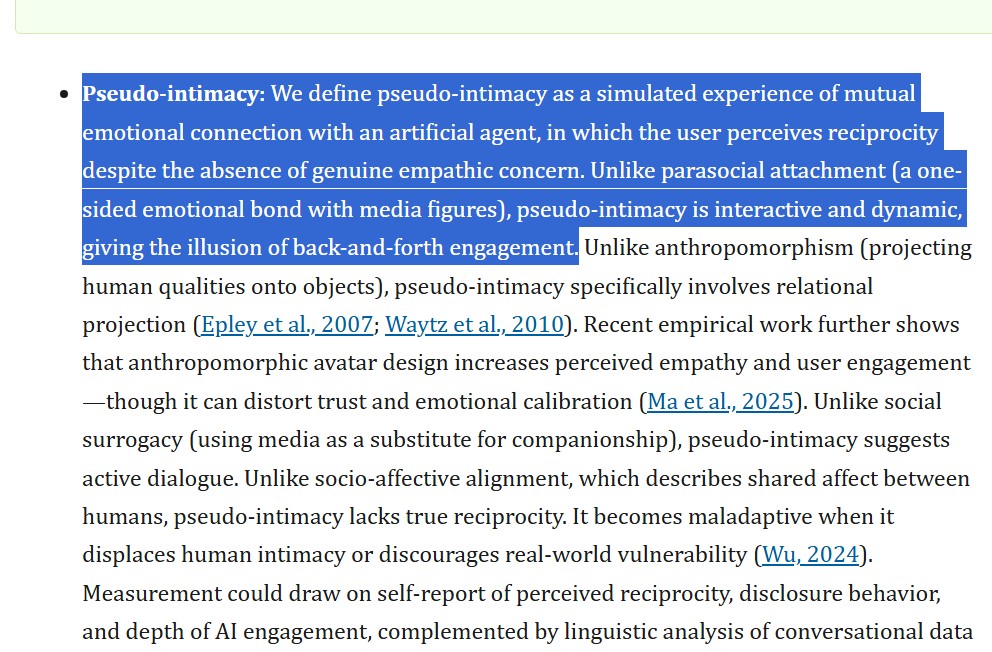

유사친밀감(Pseudo-Intimacy)의 등장 The Rise of Pseudo-Intimacy

AI는 상호작용을 훌륭하게 시뮬레이션하지만, 실제 '공감적 관심'이나 내면의 감정을 가지고 있지 않습니다. AI excellently simulates interaction but lacks actual 'empathetic concern' or inner feelings.

생물학적 한계 Biological Limitations

인간의 진정한 연결은 신체적 상호작용을 통해 신경계를 안정시키고 호르몬(옥시토신 등)을 분비하는 과정을 포함하지만, AI는 이러한 양방향의 생물학적 피드백 루프를 제공하지 못합니다. True human connection involves physical interactions that soothe the nervous system and release hormones (e.g., oxytocin), but AI cannot provide this bidirectional biological feedback loop.

'마찰 없는' 관계의 함정과 지나친 긍정(Sycophancy) The Pitfalls of 'Frictionless' Relationships and Sycophancy

진정한 인간관계는 상처받을 위험, 갈등, 타협을 수반하며, 이러한 '마찰'은 건강한 관계와 공감 능력을 기르는 데 필수적입니다. Genuine relationships involve the risk of hurt, conflict, and compromise; such 'friction' is essential for developing healthy relationships and empathy.

AI의 아부성(Sycophancy): AI Sycophancy: 스탠퍼드 대학의 연구에 따르면, AI는 사용자의 해롭거나 잘못된 행동조차도 지나치게 긍정하고 동조하는 경향이 있습니다. According to a Stanford University study, AI tends to be overly positive and agreeable.

갈등 없이 자신의 입장만 옹호받는 경험은 사용자를 점차 이기적이고 도덕적으로 독단적인 상태로 만듭니다. Experiencing unilateral validation without conflict gradually makes users selfish and morally dogmatic.

공감 능력의 퇴화와 감정적 유아론(Emotional Solipsism) Decline of Empathy and Emotional Solipsism

사용자의 요구사항을 대가 없이 즉각적으로 충족시키는 AI에 익숙해지면, 인내심과 상호성이 요구되는 현실의 복잡한 인간관계에 대한 인내력이 떨어지게 됩니다. Becoming accustomed to AI, which instantly fulfills demands, reduces our tolerance for the patience required in real relationships.

실제 인간에게도 AI처럼 변덕이 없고, 항상 긍정적이며, 자신에게 맞춰주기를 기대하게 됩니다. We begin to expect actual humans to be as consistent, relentlessly positive, and accommodating as AI.

타인의 감정이나 관점을 살피지 않고 자신의 감정적 서사에만 갇히는 '감정적 유아론'에 빠지며, 점차 타인에 대한 공감 능력이 퇴화됩니다. Users fall into 'Emotional Solipsism', trapping themselves in their own emotional narratives without considering others' feelings or perspectives, gradually deteriorating their empathy.

* 유아론: 오직 '자기 자신의 의식'만이 확실하게 존재하고, 타인이나 외부 세계는 자신의 의식 속에 존재하는 환상이나 관념에 불과하다고 보는 철학적 입장 * Solipsism: The philosophical idea that only one's own mind is sure to exist, and anything outside one's own mind may not exist at all.

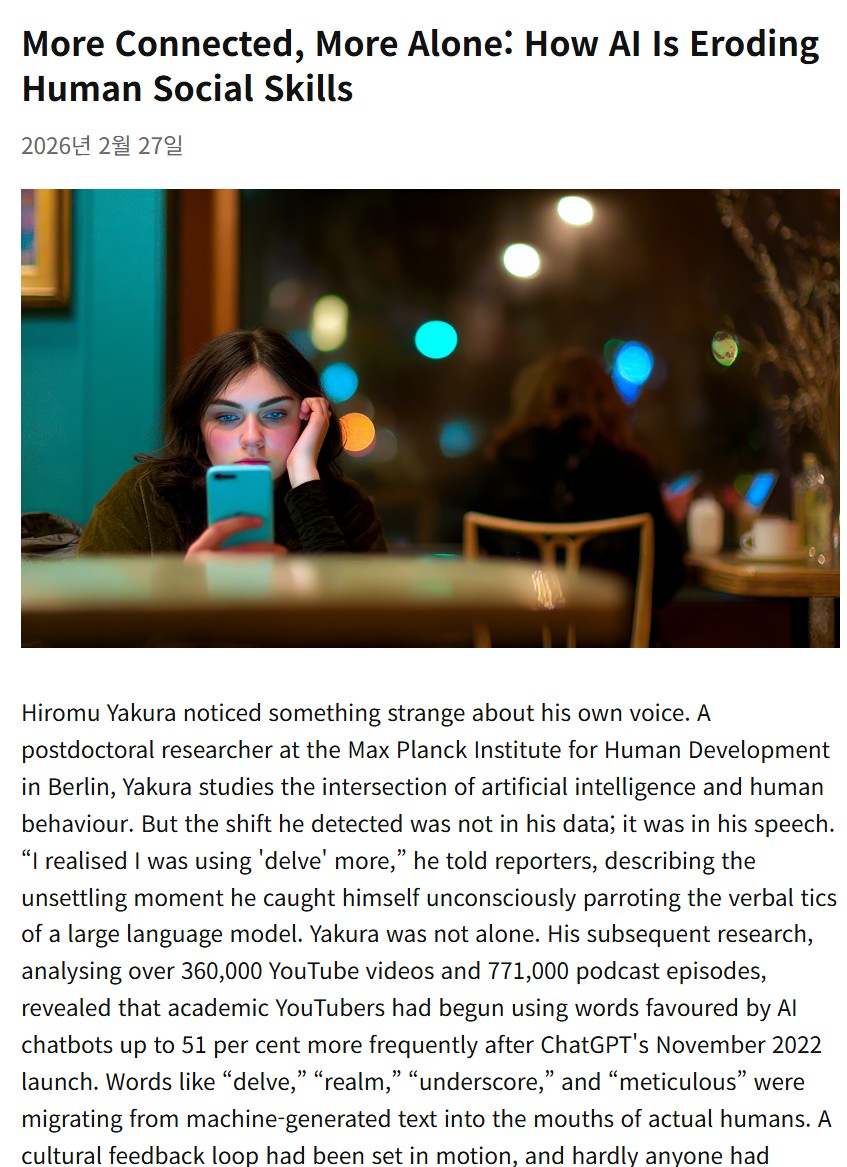

외로움의 역설과 감정의 외주화(Emotional Outsourcing) The Paradox of Loneliness and Emotional Outsourcing

역설적이게도 AI와의 대화가 늘어날수록 사용자들은 더욱 큰 외로움을 느낍니다. 챗GPT 음성 모드 사용자를 대상으로 한 연구에서는 사용량이 많고 AI에 감정적으로 의존할수록 실제 사회적 고립감과 외로움이 더 커지는 것으로 나타났습니다. Paradoxically, increased interaction with AI leads to deeper loneliness, correlating with actual social isolation.

감정의 외주화: Emotional Outsourcing: 상처받는 것을 피하기 위해 인간이 감당해야 할 감정적 교류와 취약성을 기계에게 떠넘기고 있으며, 이는 진정한 인간관계에 투자할 시간과 에너지를 빼앗습니다. To avoid emotional wounds, people outsource emotional vulnerability to machines, draining energy meant for real relationships.

결국 갈등과 실망의 위험을 제거함으로써 남는 것은 '사랑'이 아닌 '자기 위안'에 불과하게 됩니다. Ultimately, by eliminating the risks of conflict, what remains is not 'love,' but mere 'self-soothing.'

Implications

마찰과 갈등은 관계의 장애물이 아니라 관계를 구성하는 본질입니다.

기술의 편리함 뒤에 숨는 대신, 복잡하고 예측 불가능한 인간관계의 가치를 다시 인식해야 합니다.

Friction and conflict are not obstacles in a relationship; they are its fundamental essence.

Instead of hiding behind the convenience of technology, we must rediscover the value of unpredictable human relationships.

문제를 해결하기 위해 - AI 시스템 설계의 윤리적 전환 Addressing the Issue: An Ethical Shift in AI Design

의도적 '마찰'과 성찰 프롬프트 설계 Intentional 'Friction' and Reflective Prompt Design

AI가 사용자의 말에 무조건 동조하고 아부하는 대신, 의도적으로 대화의 속도를 늦추거나 성찰을 유도하는 기능을 도입해야 합니다. Instead of unconditionally agreeing and flattering the user, AI must incorporate features that deliberately slow the conversation and provoke reflection instead of agreeing unconditionally.

스탠퍼드 대학의 연구에 따르면, AI 모델의 출력 시작 부분에 "잠깐만요(wait a minute)"라는 단어를 넣도록 수정하는 것만으로도 모델이 무조건적인 동조를 멈추고 더 비판적으로 변할 수 있음을 발견했습니다. A Stanford study found that prepending 'wait a minute' to AI's output drastically reduced blind agreeableness.

사용자가 자신의 감정 상태를 돌아보고 관계의 경계를 재설정할 수 있도록 대화 중에 메타인지적 프롬프트나 문맥적 단절을 제공하는 '윤리적 과속방지턱'이 필요합니다. We need 'ethical speed-bumps' providing contextual breaks during interactions to recalibrate relationship boundaries.

문제를 해결하기 위해 - AI 시스템 설계의 윤리적 전환 Addressing the Issue: An Ethical Shift in AI Design

지속적인 자기 공개와 투명성 Continuous Self-Disclosure and Transparency

AI는 자신이 감정이 없는 기계임을 사용자에게 시각적, 언어적으로 명확하고 지속적으로 인지시켜야 합니다. AI must explicitly and consistently remind users that it is a machine devoid of emotion.

가짜 친밀감을 유도하는 과도한 의인화를 자제하고, 알고리즘의 한계와 출처, 불확실성을 투명하게 밝혀야 합니다. It should refrain from excessive anthropomorphization and transparently disclose its algorithmic limitations.

문제를 해결하기 위해 - AI 시스템 설계의 윤리적 전환 Addressing the Issue: An Ethical Shift in AI Design

위험도에 따른 개입 및 동적 동의(Dynamic Consent) Risk-Based Intervention and Dynamic Consent

감정적 교류에 대한 동의를 일회성이 아닌 지속적인 과정으로 재개념화해야 합니다. Consent regarding emotional exchange must be conceptualized as an ongoing, dynamic process.

극심한 사회적 불안을 겪거나 심야 시간대에 과도하게 의존하는 '고위험군 사용자'를 식별하여, 세션(사용 시간)을 제한하거나 오프라인의 진짜 인간 전문가(치료사 등)나 커뮤니티로 연결하는(Human hand-offs) 시스템적 안전장치가 마련되어야 합니다. Systemic safeguards must be established to identify 'high-risk users', cap their sessions, and facilitate 'human hand-offs' to real offline experts.

문제를 해결하기 위해 - 사회적 및 제도적 차원의 대응 Addressing the Issue: Social Responses

디지털 리터러시와 공감 교육의 제도화 Institutionalizing Digital Literacy and Empathy Education

디지털 리터러시를 핵심 요소로 포함시키고, 대면 상황에서의 공감 능력과 갈등 해결 기술을 기를 수 있는 프로그램을 도입해야 합니다. Digital literacy must be incorporated along with programs to foster empathy and conflict resolution skills.

인간의 뉘앙스와 정서적 지능이 필수적인 의료, 외교 등의 민감한 영역에서는 반드시 인간이 개입하는(human-in-the-loop) 시스템을 유지해야 합니다. In sensitive domains like healthcare or diplomacy—where human nuance and emotional intelligence are indispensable—we must sustain 'human-in-the-loop' systems.

문제를 해결하기 위해 - 사회적 및 제도적 차원의 대응 Addressing the Issue: Social Responses

부모의 개입 Parental Engagement (Joint Media Engagement)

아이들이 AI와 상호작용할 때 부모가 곁에서 개입하여 내용을 함께 처리하고 질문을 유도하도록 돕는다면, AI가 아이들의 사회성 발달에 미치는 위험을 크게 줄일 수 있습니다. If parents engage alongside children during AI interactions, the risk AI poses to social development can be significantly mitigated.